高级辅助驾驶系统:驾驶员应知应会!

时间:10-23

来源:互联网

点击:

策略分类

对于所有的难题,分类引擎还远远不够。对物体分类如果能够成功的话,会产生物体列表,标识上距离和速度等实际属性,根据其可能的身份进行分类,例如,人、绿化灌木,或者建筑符号等。在分类过程中,也应该针对其在 ADAS 判决过程中的重要性而标上属性:非常危险、导航线索,或者无关的背景等。还应该对分类的不确定性等级进行评价。分类功能应使用各种不同的滤波器、神经网络以及基于规则的分类树,通过融合不同传感器的数据得出自己的结论。

现在,问题的本质发生了很大变化。至少在一些较好的条件下,ADAS 系统非常详细的知道其位置和环境。现在,它必须决定下一步做什么,特别是出现不确定性因素时。就目前而言,这意味着基于规则的系统。

Ayrapetian 解释说:“您可以使用神经网络来识别物体,甚至是把汽车放在周围环境中。但是,您需要规则来得出判断,并解释。”

使用基于规则的系统来决定 ADAS 响应的基本原因可能在于我们对神经网络工作方式的感情因素。可以训练深度学习网络,使其能够比人更正确的理解环境—也就是,99% 的时间都能够正确理解被测试的视频。但是,即使对金色猎犬有 1% 的误解人们也不会满意:我们要的是非常可靠的规则,决不能撞上一条小狗。

更深层次的问题在于系统验证和控制兼容问题。很多工程师都强烈的感受到,在相信一款设计之前,必须能够理解设计是怎样工作的—实际上,在规划验证策略之前。而且,符合某些规则要求设计中的每一组成都是可追溯的,回溯到最初的需求来源。所有这些需求对于神经网络而言都是切实的问题,人很难完全理解网络中某一阶段在干什么,也不能追溯回系统需求文档的某些章节。

相反,基于规则的系统一般非常直观:您可以读取一条规则,知道为什么在此处要采用它。但是,基于规则的系统实行起来也有局限。很难设计一个能够在不可预见的环境中正常工作的系统—务要求很好的进行抽象思维,找到胜任于某些环境的规则。随着规则的增多,计算要求和行为预测都会带来问题。例如,有可能加入看起来非常合理的规则,不经意间,在基于规则的判断树上设立了死循环,或者,建立了无法实时遍历的规则列表。

除了混合神经网络和规则之外,还有第三种因素。很多系统设计人员觉得根本不可能只从传感器数据中得出正确的环境模型,因此,他们要求来自基础设施的数据:来自道路和十字路口的固定传感器的数据,以及从其他车辆送来的数据。Ng-Thow Hing 观察到,“在日本,计划是使用智能基础设施来实现问题追溯。” 道路传感器可以定位车辆,非常精确的测量其速度,减少物体识别和分类的压力,从而减少判断单元的不确定性。来自其他车辆的数据是另一关键参数,车内传感器很难理解这些数据:其他车辆要往哪里开。

但是,基础设施数据需要非常好的社会组织,还要考虑政治因素,以及只有少数国家能够承担得起的投入等。因此,目前世界上大部分 ADAS 设计人员还不能依靠这些。Schumacher 提醒说:“最后,您还需要地图信息,需要基础设施信息。我们还有时间来‘靠边停车’。”

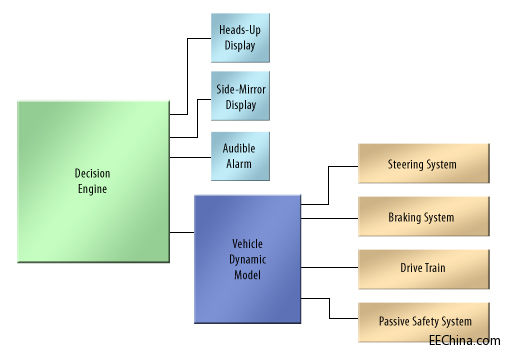

无论ADAS判断阶段采用哪种实施计划,它都必须产生两类输出 (图2)。第一类是必须的,输出至人机接口,告诉并提醒驾驶员。第二类输出—只是在某些设计中有,只用于某些环境中,直接作用在车辆主系统上:转向,刹车,传动等,如果所有这些都失效了,那么还有被动安全系统。

图2. 判断系统有两类不同的基本输出流。

可能让人吃惊的是,最热门的争议是人机接口:它什么时候应该起作用,怎样起作用?福特公司的 Buczkowski 在其 DAC 主题演讲中,建议应该让驾驶员感到 “这辆车很理解我—也是这么干的。”

这就说明了问题:对于驾驶员,ADAS是有个性的。Schumacher 提醒说:“如果错误的反应太多,或者系统太谨慎了,那么,驾驶员就会把它关掉。” Ng-Thow Hing 对此表示同意:“其复杂性在于有很多不同的驾驶习惯。” 谨慎的驾驶员喜欢报警甚至是直接干预。冲动的驾驶员不愿意受到干涉;甚至是那些符合安全驾驶要求的干涉。如果他们觉得 ADAS 系统让他们在乘客面前出丑了,他们会永久关掉系统。

Schumacher 解释说:“例如,道路保持功能在提醒驾驶员时,乘客也会很清楚的知道。如果设计成直接干预,可以通过控制转向系统或者采用不同的刹车扭矩来完成。一种方法要比其他方法作用更明显。”

让人分散注意力也是问题。人机接口必须引起驾驶员的注意,并给出正确反应的建议。不能给出不具指导性的警报,这只能进一步分散驾驶员的注意力—特别是在某些紧急时刻。

Altera 自动化 传感器 汽车电子 Cadence 滤波器 神经网络 嵌入式 DAC 相关文章:

- 基于SoPC的汽车安全监控系统设计(07-09)

- FPGA实现的FIR算法在汽车动态称重仪中的应用(07-15)

- 基于ADPCM算法的汽车智能语音报警系统的设计(08-03)

- 如何进行汽车电子系统中的处理器选择(09-21)

- FPGA到ASIC的整合为车用微控制器带来灵活性(09-25)

- 基于SoPC汽车安全监控系统设计(09-14)