智能机器人四大分类详细说明

很大,所以只考虑了U和V的值,在进行颜色判断时,首先分别建立U、V的阈值向量。

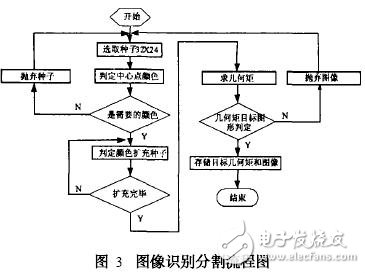

由于在系统中图像传感器的数字信号是8位,即1Byte,共255Byte,系统最多能判定8种颜色。在颜色识别后进行图像分割,在图像分割中采用了 种子填充算法,其整个种子的填充是和像素点的颜色同时进行的,一开始不是对所有的像素进行处理,而是分块进行的,本系统采用的块是32×24像素,这样计 算量大大减小。当中心点是所要识别的颜色时,就以这个点为种子向四周扩散,并判定周围像素点的颜色,直到填满整个块。在这过程中,同时对目标进行形状识 别。本系统采用了基于全局的特征向量的识别算法来进行识别。同时也为构建雅可比矩阵得到需要的矩特征量。图3为图像识别分割流程图。

2.3 视觉跟踪软件原理

当目标物体被识别以后,视觉系统将调整镜头使目标位于视野的中心。一旦物体运动,视觉系统将进行对目标物体的跟踪。

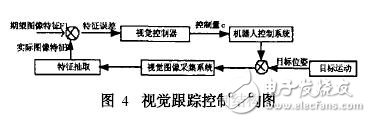

在机器人视觉跟踪系统上,采用无定标的视觉跟踪系统。无定标的视觉跟踪不需要事先对摄像镜头进行定标,而是应用自适应控制方面的原理,在线的实时调整 图像雅可比矩阵。通过二维的图像特征信息反馈,这种方式对摄像机模型误差和机器人模型误差、图像误差、图像噪声不敏感。基于图像跟踪的视觉跟踪控制系统, 如图4。

控制量c为机器人头部的控制系统。首先把目标放在机器人视野的前方采集到期望的图像,从期望图像中抽取期望的特征集,作为视野跟踪控制系统的期望输 入,从而完成任务需要的视野特征集定义。在实时控制系统中,由机器人的图像传感器获取实时采样图像,从中获取实时特征集,这样构成一个视野反馈,引导机器 人完成跟踪任务。区别于图像的简单几何特征,本系统选用的视觉特征集为全局的图像描述—图像矩。

根据矩特征变化量与相对位姿变化量之间的关系矩阵,即图像雅可比矩阵,然后利用推导的图像雅可比矩阵,设计了视觉跟踪控制器,完成系统对3D目标物体的平动跟踪。

3 实验结果

图5为DSP为clkout脚输出波形,表明DSP的内部时钟电路工作正常。图6的图像传感器输出数据波形证明了图像传感器工作正常。图7的DSP采集到的图像数据,可以确定整个图像采集硬件电路工作正常。

4 结 论

针对服务机器人的视觉系统,本文通过构建它的硬件系统和软件系统完成了整个系统的设计。在硬件系统上,采用了CMOS图像传感器,CPLD时序控制, 异步动态FIFO的数据缓存,以及高速DSP处理器构成了一个典型的图像采集系统,并调试输出了图像信号。在软件设计上,采用了足球机器人的彩色识别和彩 色分割识别技术去完成视觉系统快速准确的识别,采用基于动态的工作方式以及采用基于图

- 机器人要走入智能家居还需突破什么?(10-14)

- 深度解读美国服务机器人技术路线图(09-18)

- 基于STM32的家庭服务机器人系统设计(02-13)

- 智能机器人在家庭医疗保健的设计和应用(09-19)

- 萌萌哒的智能机器人前台(09-05)

- 工业机器人过去与现在对比(02-16)