都是瞄准人工智能市场,谷歌TPU与GPU、FPGA到底有啥不同?

目前,Google、Facebook、Microsoft、百度等科技巨头纷纷涉足人工智能。市场对人工智能的热情持续高涨,特别是硬件领域。有分析师指出,人工智能将成为下一个科技风口,主要的就包括硬件。

前几天,AlphaGo确定5月份要来到中国,对战当前世界排名第一的围棋选手柯洁,它是否能打败柯洁,变的势不可挡?去年,在AlphaGo打败李世乭的时候,或许我们都曾想过,它怎么能这么聪明,是什么支撑了一个机器人的强大快速的运算能力呢?

没错,关键就是谷歌的TPU。在图像语音识别、无人驾驶等人工智能领域的运用层面,图形处理器 (GPU)正迅速扩大市场占比,而谷歌专门为人工智能研发的TPU则被视为GPU的竞争对手。TPU是什么?它怎么就被视为GPU的竞争对手了呢?

人工智能各要素的概念

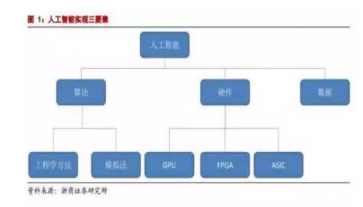

人工智能的实现三s需要依赖三个要素:算法是核心,硬件和数据是基础。

算法主要分为为工程学法和模拟法。工程学方法是采用传统的编程技术,利用大量数据处理经验改进提升算法性能;模拟法则是模仿人类或其他生物所用的方法或者技能,提升算法性能,例如遗传算法和神经网络。

硬件方面,目前主要是使用 GPU 并行计算神经网络。

下图就可体现这些要素之间的关系:

从产业结构来讲,人工智能生态分为基础、技术、应用三层。

基础层包括数据资源和计算能力;技术层包括算法、模型及应用开发;应用层包括人工智能+各行业(领域),比如在互联网、金融、汽车、游戏等产业应用的语音识别、人脸识别、无人机、机器人、无人驾驶等功能。

什么是TPU

TPU,即谷歌的张量处理器--Tensor Processing Unit。

据谷歌工程师Norm Jouppi介绍,TPU是一款为机器学习而定制的芯片,经过了专门深度机器学习方面的训练,它有更高效能(每瓦计算能力)。大致上,相对于现在的处理器有7年的领先优势,宽容度更高,每秒在芯片中可以挤出更多的操作时间,使用更复杂和强大的机器学习模型,将之更快的部署,用户也会更加迅速地获得更智能的结果。谷歌专门为人工智能研发的TPU被疑将对GPU构成威胁。不过谷歌表示,其研发的TPU不会直接与英特尔或NVIDIA进行竞争。

TPU最新的表现正是人工智能与人类顶级围棋手的那场比赛。在AlphaGo战胜李世石的系列赛中,TPU能让AlphaGo"思考"更快,"想"到更多棋招、更好地预判局势。

深度学习的运算流程

对于任何运算来说,更换新硬件无非是为了两个目的:更快的速度和更低的能耗。而深度学习这个看起来玄乎的词语,究其本质也不过是大量的运算。我们都知道那句老话:万能工具的效率永远比不上专用工具。无论是CPU、GPU还是FPGA,其属性都算是一种通用工具。因为它们都可以应付许多不同的任务。而专用的TPU自然从道理上来说就应该会比前面几种硬件的效率都要高。这里的效率高,既是指速度更快,也是指能耗会更低。

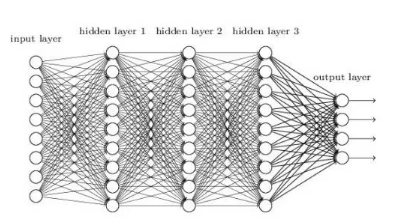

但我们不能光讲道理,也要摆出一些数据。实际上,Xilinx曾经表示在特定的FPGA开发环境下深度学习的能效比会达到CPU/GPU架构的25倍,不是一倍两倍, 是25倍!同学们可以拿出纸和笔了,让我们举一个实际的例子来讲讲这种效率提升的原因:以在深度神经网络(DNN)上进行的图像识别为例子,网络的整个结构大致是这样的:

其中除输入层是用来将图像的特征提取为函数、输出层用来输出结果外,其他的隐层都是用来识别、分析图像的特征的。当一幅图被输入时,第一层隐层会首先对其进行逐像素的分析。此时的分析会首先提取出图像的一些大致特征,如一些粗略的线条、色块等。如果输入的是一张人脸的图像,则首先获得的会是一些倾斜的颜色变换。

第一层的节点会根据自己对所得信号的分析结果决定是否要向下一层输出信号。而所谓的分析过程,从数学上来看就是每个隐层中的节点通过特定的函数来处理相邻节点传来的带权重值的数据。并决定是否向下一层输出结果,通常每一层分析完成后便有些节点不会再向下一层输出数据,而当下一层接收到上一层的数据的时候,便能在此基础上识别出一些更复杂的特征,如眼睛、嘴巴和鼻子等,

逐次增加辨识度之后,在最高一层,算法会完成对面部所有特征的识别,并在输出层给出一个结果判断。基于不同的应用,这个结果可能有不同的表现。比如分辨出这是谁的脸。

谷歌的TPU对其他厂商有什么影响?

在TPU发布之前,这个领域内的大多数厂商都在同时利用FPGA和GPU来改进训练自己的神经网络算法。NVIDIA则是其中比较特殊的一家:它是世界最大的GPU制造商之一,一直在不遗余力的推广自己的产品在深度学习领域的应用。但其实GPU的设计初衷主要并不是进行神经网络运算,而是图像处理。更多是由于其特殊的构造碰巧也比较适用于神经网络运算罢了,尽管NVIDIA也在推出一些自有的深度学习算法,但由于GPU自身的特性一直还是被FPGA压着一头。而此次的TPU会让这个市场上凭空再多一个竞争对手,因此我认为这款TPU对NVIDIA的影响是最大的。

另一些在人工智能领域已经与谷歌有着相似程度的成就的公司则预计不会受到太多影响,如微软和苹果。微软一直在探索FPGA对人工智能相关运算的加速,并且有自己开发的算法。经过长时间的调试,基于FPGA的这些算法也未必会在最终表现上输给谷歌多少。如果微软愿意,其实它也可以随时开始开发一款自己的人工智能芯片,毕竟微软也是自己开发过很多专属硬件的了。

- 大尺寸面板价格不涨反跌 市场供需失衡难落幕(07-29)

- Fairchild推出全新品牌,标志着公司的重大转型(03-19)

- 飞兆半导体附属公司崇贸科技荣获发明创作奖(05-14)

- Fairchild通过收购Xsens将战略步伐跨入 快速增长的3D运动追踪市场(05-15)

- Fairchild宣布2014年度北美洲和亚洲功率技术研讨会时间表(04-15)

- Fairchild与Xsens的结合水到渠成(06-09)