人工智能(AI)芯片产业生态梳理

AI芯片作为产业核心,也是技术要求和附加值最高的环节,在AI产业链中的产业价值和战略地位远远大于应用层创新。腾讯发布的《中美两国人工智能产业发展全面解读》报告显示,基础层的处理器/芯片企业数量来看,中国有14家,美国33家。本文将对这一领域产业生态做一个简单梳理。

AI芯片分类1

从功能来看,可以分为Training(训练)和Inference(推理)两个环节。

Training环节通常需要通过大量的数据输入,或采取增强学习等非监督学习方法,训练出一个复杂的深度神经网络模型。训练过程由于涉及海量的训练数据和复杂的深度神经网络结构,运算量巨大,需要庞大的计算规模,对于处理器的计算能力、精度、可扩展性等性能要求很高。目前在训练环节主要使用NVIDIA的GPU集群来完成,Google自主研发的ASIC芯片TPU2.0也支持训练环节的深度网络加速。

Inference环节指利用训练好的模型,使用新的数据去"推理"出各种结论,如视频监控设备通过后台的深度神经网络模型,判断一张抓拍到的人脸是否属于黑名单。虽然Inference的计算量相比Training少很多,但仍然涉及大量的矩阵运算。在推理环节,GPU、FPGA和ASIC都有很多应用价值。

从应用场景来看,可以分成"Cloud/DataCenter(云端)"和"Device/Embedded(设备端)"两大类。

在深度学习的Training阶段,由于对数据量及运算量需求巨大,单一处理器几乎不可能独立完成一个模型的训练过程,因此,Training环节目前只能在云端实现,在设备端做Training目前还不是很明确的需求。

在Inference阶段,由于目前训练出来的深度神经网络模型大多仍非常复杂,其推理过程仍然是计算密集型和存储密集型的,若部署到资源有限的终端用户设备上难度很大,因此,云端推理目前在人工智能应用中需求更为明显。GPU、FPGA、ASIC(Google TPU1.0/2.0)等都已应用于云端Inference环境。在设备端Inference领域,由于智能终端数量庞大且需求差异较大,如ADAS、VR等设备对实时性要求很高,推理过程不能交由云端完成,要求终端设备本身需要具备足够的推理计算能力,因此一些低功耗、低延迟、低成本的专用芯片也会有很大的市场需求。

按照上述两种分类,我们得出AI芯片分类象限如下图所示。

除了按照功能场景划分外,AI芯片从技术架构发展来看,大致也可以分为四个类型:

1、通用类芯片,代表如GPU、FPGA;

2、基于FPGA的半定制化芯片,代表如深鉴科技DPU、百度XPU等;

3、全定制化ASIC芯片,代表如TPU、寒武纪 Cambricon-1A等;

4、类脑计算芯片,代表如IBM TrueNorth、westwell、高通Zeroth等。

AI芯片产业生态2从上述分类象限来看,目前AI芯片的市场需求主要是三类:

1、面向于各大人工智能企业及实验室研发阶段的Training需求(主要是云端,设备端Training需求尚不明确);

2、Inference On Cloud,Face++、出门问问、Siri等主流人工智能应用均通过云端提供服务;

3、Inference On Device,面向智能手机、智能摄像头、机器人/无人机、自动驾驶、VR等设备的设备端推理市场,需要高度定制化、低功耗的AI芯片产品。如华为麒麟970搭载了"神经网络处理单元(NPU,实际为寒武纪的IP)"、苹果A11搭载了"神经网络引擎(Neural Engine)"。

(一)Training训练

2007年以前,人工智能研究受限于当时算法、数据等因素,对于芯片并没有特别强烈的需求,通用的CPU芯片即可提供足够的计算能力。Andrew Ng和Jeff Dean打造的Google Brain项目,使用包含16000个CPU核的并行计算平台,训练超过10亿个神经元的深度神经网络。但CPU的串行结构并不适用于深度学习所需的海量数据运算需求,用CPU做深度学习训练效率很低,在早期使用深度学习算法进行语音识别的模型中,拥有429个神经元的输入层,整个网络拥有156M个参数,训练时间超过75天。

与CPU少量的逻辑运算单元相比,GPU整个就是一个庞大的计算矩阵,GPU具有数以千计的计算核心、可实现10-100倍应用吞吐量,而且它还支持对深度学习至关重要的并行计算能力,可以比传统处理器更加快速,大大加快了训练过程。

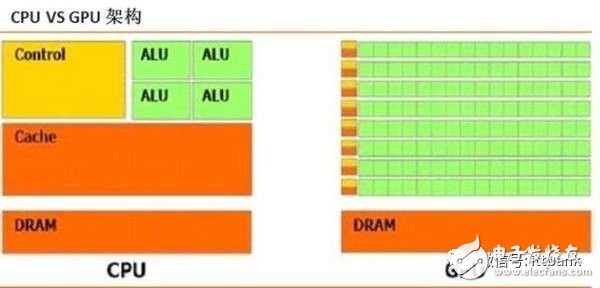

从上图对比来看,在内部结构上,CPU中70%晶体管都是用来构建Cache(高速缓冲存储器)和一部分控制单元,负责逻辑运算的部分(ALU模块)并不多,指令执行是一条接一条的串行过程。GPU 由并行计算单元和控制单元以及存储单元构成,拥有大量的核(多达几千个)和大量的高速内存,擅长做类似图像处理的并行计算,以矩阵的分布式形式来实现计算。同CPU不同的是,GPU的计算单元明显增多,特别

- 大联大友尚集团推出基于Fairchild器件的LED照明电源解决方案(11-19)

- AI/机器学习/深度学习三者的区别是什么?(09-10)

- 阿里AI LABS与庆科信息联合推出儿童语音智能解决方案(04-05)

- 盘点人工智能技术的应用领域(05-01)

- foxmail如何设置有自定义背景的邮件模版(04-11)

- 电脑组建RAID 0的要诀(03-01)