三方面详解如何为机器人构建起一个“三维世界”

从本科到研究生阶段,再到2014年出来创业以后,这前后大概5年的时间里,我始终聚焦在视觉领域的学习。所以能够比较清晰地看到,在这几年时间里,以视觉为核心的,包括人脸识别、物体识别、空间定位、导航避障等在内的感知层算法正在随着底层人工智能的基础型算法架构(比如我们现在熟知的机器学习、深度学习,以及最近很火的增强学习)和硬件传感器的发展产生着日新月异的变化。

在实验室的时候,我的主要研究方向是为特种机器,包括微小型的无人机、功能性的机器人构建一套以视觉感知为主的机器人视觉系统,而在2011年后发展起来的这一波感知层算法的进步与传感器硬件上面的推陈出新恰恰为这样的研究提供了有利的支持,以至于到今天推动了整个资本市场上对于人工智能项目的大热与追捧。

下面,我将从机器人视觉系统、视觉技术原理和未来发展趋势三个方面,为大家讲述我们是如何为机器人构建起一个"三维世界"的。

机器人视觉系统发展与三维视觉的兴起

我们知道"机器人"这一名词是1920年一位捷克作家在一本科幻剧中提出的,到了1950年前后,另一位美国作家阿西莫夫才系统性的提出了"机器人学"这一概念,并给出了著名的机器人三定律。在那之后,从1970年,随着计算机的兴起,现代控制技术、传感器技术的发展,机器人开始了真正的产品化的进程。也正是从那个时候开始,搭载一颗基于CCD芯片摄像头的机器人,可以为人们提供某一时刻的光学影像信息记录,而这也形成了最早期的机器人视觉系统。值得一提的是,1969年美国的阿波罗登月飞船上搭载的正是基于CCD感光芯片的照相机,为机器人视觉系统的硬件架构提供了系统性的参照。由于具备一定的简单的记忆存储能力,那个时候的机器人可以进行简单的重复作业,但是对周围环境没有任何感知与反馈控制能力,我们称当时的机器人为第一代机器人。

时间推进到80年代,视觉传感器、力触觉传感器、接近传感器和计算机在这一时期进入到了快速发展期,特别是摩尔定律的发现代表着信息技术的发展速度在这一时期确确实实到了顶峰。这一时期的机器人已经具备了一定的感知能力,能够获取作业环境与作业对象的部分信息,并进行一定的实时处理,引导机器人进行作业。比如下图我们看到的当时美国斯坦福研究所开发实现的Shakey移动机器人,拥有电子摄像头、测距仪等感知设备,建立了一套底层到顶层的分层控制机制和当时最先进的视觉系统,用来帮助机器人在非结构化的环境中进行独立的推理、运动规划与实时控制。这是当时人工智能技术应用于移动机器人最为成熟的成果之一,Shakey的诞生自此也揭开了智能移动机器人研究的大幕。

自此以后,世界各国都开始投入到了对移动机器人的研究上,而在这之中,视觉系统更是被公认为是机器人走向智能的核心入口。因为在研究的推进中,人们需要机器人对环境拥有更完善的感知能力、逻辑思维能力、判断决策能力,甚至是根据作业要求与环境信息进行自主的工作。比如美国DARPA在90年代研究的ALV自主车可以选择路标识别实现导航,达到10km/h的移动虚度,还采用了立体视觉、卫星导航等当时的先进技术。2004年NASA研制的火星探测器机遇号与勇气号成功在火星表面登陆,搭载当时最为先进的图像采集与立体视觉技术,帮助探测器在复杂的星球表面完成各项未知任务。而也正是在这样一个时期,三维视觉系统在移动机器人上的重要性被首次提出。

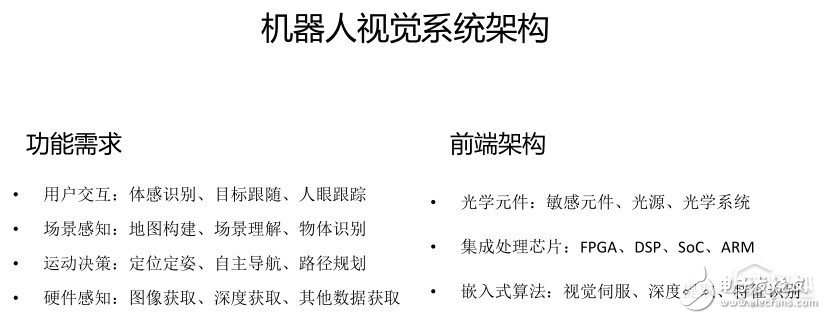

通过上面的介绍,不难发现,从上个世纪六七十年代发展起来的机器人视觉系统,到今天,实际上是建立在不同时期最先进的算法技术和硬件传感器的基础之上的。在视觉系统的算法技术上,通过几十年的发展,形成了用户交互、识别感知、运动决策和数据优化4个层级,分别对应实现体感识别、目标跟随、人眼跟随;地图构建、场景理解、物体识别;定位定姿、自主导航、路径规划;图像优化、深度优化、其他数据优化等诸多今天大家耳熟能详的算法。在硬件传感器上,也主要分为前端传感器表现,集成处理芯片和嵌入式算法三个层级。在今天的钛坦白分享课上,我会主要介绍一下三维视觉的主要实现原理。

在前面的介绍中,我们看到,机器人视觉系统一路走来,和光学传感器的演进密不可分。可以说视觉系统几十年的发展史,就是光学传感器的演进史。今天,我们大体将机器人视觉系统中搭载的视觉传感器分为三类:以单线激光雷达为代表的一维线阵传感器,以嵌入式摄像头为代表的二维面阵传感器和以特殊光源为代表的三维深度传感器。其中,以特殊光源为代表的三维深度传感器是

- SLAM技术,让真正的智能机器人触手可及(02-16)

- 机器人自主移动的秘密,从SLAM技术说起(10-21)

- 揭秘机器人自主移动背后技术,从SLAM技术说起(10-22)

- 自主移动机器人的定位与地图创建(SLAM)关键性问题(02-07)

- LT3751如何使高压电容器充电变得简单(08-12)

- 三路输出LED驱动器可驱动共阳极LED串(08-17)