语音识别技术及厂商解析 智能家居的另一大入口?

型(HMM)的方法、基于人工神经网络(ANN)和支持向量机等语音识别方法。

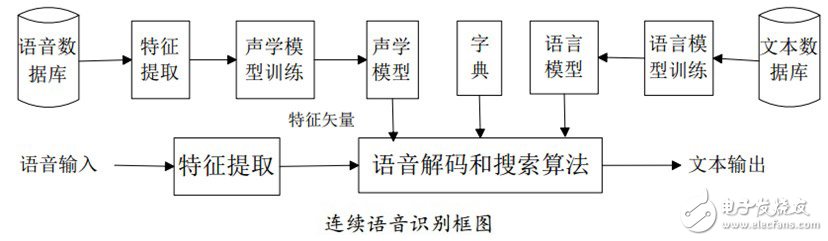

语音识别基本框图

语音识别分类:

根据对说话人的依赖程度,分为:

(1)特定人语音识别(SD):只能辨认特定使用者的语音,训练→使用。

(2)非特定人语音识别(SI):可辨认任何人的语音,无须训练。

根据对说话方式的要求,分为:

(1)孤立词识别:每次只能识别单个词汇。

(2)连续语音识别:用者以正常语速说话,即可识别其中的语句。

语音识别系统

语音识别系统的模型通常由声学模型和语言模型两部分组成,分别对应于语音到音节概率的计算和音节到字概率的计算。

Sphinx是由美国卡内基梅隆大学开发的大词汇量、非特定人、连续英语语音识别系统。一个连续语音识别系统大致可分为四个部分:特征提取,声学模型训练,语言模型训练和解码器。

(1)预处理模块

对输入的原始语音信号进行处理,滤除掉其中的不重要的信息以及背景噪声,并进行语音信号的端点检测(找出语音信号的始末)、语音分帧(近似认为在10-30ms内是语音信号是短时平稳的,将语音信号分割为一段一段进行分析)以及预加重(提升高频部分)等处理。

(2)特征提取

去除语音信号中对于语音识别无用的冗余信息,保留能够反映语音本质特征的信息,并用一定的形式表示出来。也就是提取出反映语音信号特征的关键特征参数形成特征矢量序列,以便用于后续处理。

目前的较常用的提取特征的方法还是比较多的,不过这些提取方法都是由频谱衍生出来的。

(3)声学模型训练

根据训练语音库的特征参数训练出声学模型参数。在识别时可以将待识别的语音的特征参数同声学模型进行匹配,得到识别结果。

目前的主流语音识别系统多采用隐马尔可夫模型HMM进行声学模型建模。

(4)语言模型训练

语言模型是用来计算一个句子出现概率的概率模型。它主要用于决定哪个词序列的可能性更大,或者在出现了几个词的情况下预测下一个即将出现的词语的内容。换一个说法说,语言模型是用来约束单词搜索的。它定义了哪些词能跟在上一个已经识别的词的后面(匹配是一个顺序的处理过程),这样就可以为匹配过程排除一些不可能的单词。

语言建模能够有效的结合汉语语法和语义的知识,描述词之间的内在关系,从而提高识别率,减少搜索范围。语言模型分为三个层次:字典知识,语法知识,句法知识。

对训练文本数据库进行语法、语义分析,经过基于统计模型训练得到语言模型。语言建模方法主要有基于规则模型和基于统计模型两种方法。

(5)语音解码和搜索算法

解码器:即指语音技术中的识别过程。针对输入的语音信号,根据己经训练好的HMM声学模型、语言模型及字典建立一个识别网络,根据搜索算法在该网络中寻找最佳的一条路径,这个路径就是能够以最大概率输出该语音信号的词串,这样就确定这个语音样本所包含的文字了。所以解码操作即指搜索算法:是指在解码端通过搜索技术寻找最优词串的方法。

连续语音识别中的搜索,就是寻找一个词模型序列以描述输入语音信号,从而得到词解码序列。搜索所依据的是对公式中的声学模型打分和语言模型打分。在实际使用中,往往要依据经验给语言模型加上一个高权重,并设置一个长词惩罚分数。当今的主流解码技术都是基于Viterbi搜索算法的,Sphinx也是。

语音识别技术的难点

说话人的差异

• 不同说话人:发音器官,口音,说话风格

• 同一说话人:不同时间,不同状态

噪声影响

• 背景噪声

• 传输信道,麦克风频响

鲁棒性技术

• 区分性训练

• 特征补偿和模型补偿

语音识别的具体应用

• 命令词系统

Ø 识别语法网络相对受限,对用户要求较严格

Ø 菜单导航,语音拨号,车载导航,数字字母识别等等

• 智能交互系统

Ø 对用户要求较为宽松,需要识别和其他领域技术的结合

Ø 呼叫路由,POI语音模糊查询,关键词检出

• 大词汇量连续语音识别系统

Ø 海量词条,覆盖面广,保证正确率的同时实时性较差

Ø 音频转写

• 结合互联网的语音搜索

Ø 实现语音到文本,语音到语音的搜索

- 科大讯飞李繁:多生物特征融合认证能极大降低误识率(07-17)

- 锤子M1助科大讯飞上头条 语音识别蓝海将到?(09-20)

- 科大讯飞/百度/微软发力语音识别 潜力无限?(09-21)

- 以核心技术为源头,创造一个AI混合的商业生态(05-30)

- 科大讯飞:做机器人,定位比数据更重要(07-17)

- 科大讯飞儿童智能手表评测(07-17)