据说已经达到七年后的计算水平,Google的TPU芯片大起底

的,现在披露的消息是说会用在Google的云计算平台上。

遗憾的是目前并没有太多的故事可分享,唯一一个值得注意的就是Google已经使用此芯片运行了一年多的时间,而且已经用在了其大量的产品上,说明TPU已经是一个较为成熟的设计了。

到底会不会取代GPU或CPU呢?谷歌资深副总裁Urs Holzle透露,当前谷歌TPU、GPU并用,这种情况仍会维持一段时间,但也语带玄机表示,GPU过于通用,谷歌偏好专为机器学习设计的晶片。GPU可执行绘画的运算工作,用途多元,TPU属于ASIC,也就是专为特定用途设计的特殊规格逻辑IC,由于只执行单一工作,速度更快,但缺点是成本较高。

TPU并非万能

TPU的高效能的来源正是其非万能的设计逻辑(极度单一的设计原则),正如上文所说的CPU是通用计算,而GPU相对来说虽然比CPU更不通用,但是因为GPU本身是作为显卡的处理器产生的,所以GPU也是相对通用的。而TPU为专用的逻辑电路,单一工作,速度快,但由于其是ASIC,所以成本高。

另外一点有可能是TPU的暂时的缺点就是TPU现在为Google专用,还不是消费类产品,而要走向流行的消费类产品,还需要现在市场的软硬件进行配合,这也是需要一定的时间的,而且会不会得到市场最终认可也是存在疑问的。所以TPU非常不万能。

只是TPU的发布,有一点很重要的意义:现在的深度学习生态环境已经非常重视这些硬件的升级了,这些定制硬件的春天就要到来,最终这个市场鹿死谁手真是无法预料,而国内在这方面并不落后,如寒武纪,地平线这样公司也正在这方面摩拳擦掌。

虽然TPU带来了突破性进步,但这并不代表会完全淘汰CPU和GPU,目前主要会用来解决集成电路存在的成本高、耐用性差的问题。值得期待的事,Google是互联网性质的企业,在硬件制作上能否超越传统的硬件产商(如Nvidia,Intel等), 我们可以静观其变。

|目前的深度学习硬件设备还有哪些?与传统CPU有何差异?

那么目前深度学习的主要硬件设备与传统CPU的差异有哪些呢?

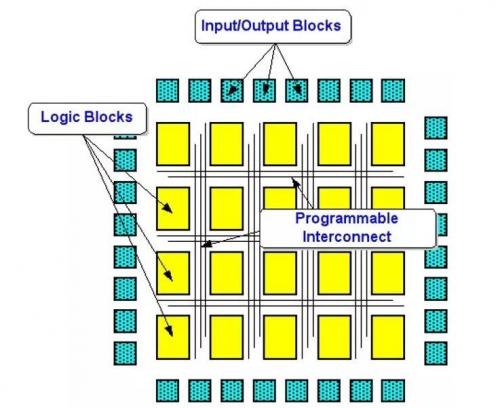

FPGA

FPGA最初是从专用集成电路发展起来的半定制化的可编程电路,它无法像CPU一样灵活处理没有被编程过的指令,但是可以根据一个固定的模式来处理输入的数据然后输出,也就是说不同的编程数据在同一片FPGA可以产生不同的电路功能,灵活性及适应性很强,因此它可以作为一种用以实现特殊任务的可再编程芯片应用与机器学习中。

譬如百度的机器学习硬件系统就是用FPGA打造了AI专有芯片,制成了AI专有芯片版百度大脑--FPGA版百度大脑,而后逐步应用在百度产品的大规模部署中,包括语音识别、广告点击率预估模型等。在百度的深度学习应用中,FPGA相比相同性能水平的硬件系统消耗能率更低,将其安装在刀片式服务器上,可以完全由主板上的PCI Express总线供电,并且使用FPGA可以将一个计算得到的结果直接反馈到下一个,不需要临时保存在主存储器,所以存储带宽要求也在相应降低。

GPU

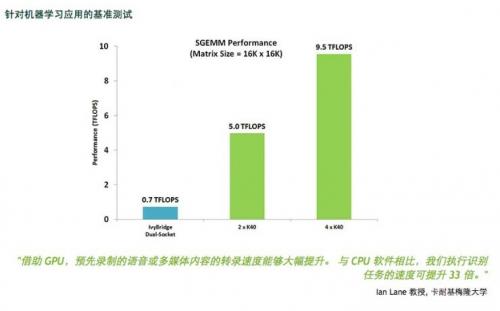

GPU是相对于CPU的一个概念,是一个专门的图形的核心处理器,计算机中的GPU是显卡的"心脏",也就是相当于CPU在电脑中的作用。但是因为GPU在浮点运算、并行计算等部分的计算方面能够提供数十倍至上百倍的CPU性能,所以开始利用GPU来运行机器学习模型,以便于在云端进行分类和检测,同样的大训练集,相对于CPU耗费的时间大幅度缩短,占用的数据中心的基础设施也少很多,所以GPU在耗费功率更低、占用基础设施更少的情况下能够支持远比单纯使用CPU时10-100倍的应用吞吐量。

譬如图像识别领域的图普科技,则是基于大规模GPU集群搭建了AI超算平台,能够支持亿万级别图像的全面实时处理,并且利用深度学习算法设计的智能程序能通过快速迭代拥有强大的学习能力,实现高精度的智能识别结果。

而语音识别领域的科大讯飞,目前在深度学习训练方面,几乎所有的运算包括CNN、RNN等都是放在GPU加速卡上的,并且其还计划在语音识别业务中启用FPGA平台,通过重新设计硬件架构在未来建造一个上万规模的FPGA语音识别系统。

所以可以说,要实现让机器能像人类一样思考,企业不仅需要在算法模型的精确度上下功夫,同时高性能计算能力的硬件系统也是非常需要关注的,这些异构加速技术协助处理器运算速度的快速提升,让机器学习应用领域的硬件层面难度降低。

但是现在这些只是一个开始,更多的软硬件创新肯定还在进行中,不知道是否有一天,这些创新是否也会帮助AI超越人类呢?

- 大尺寸面板价格不涨反跌 市场供需失衡难落幕(07-29)

- Fairchild推出全新品牌,标志着公司的重大转型(03-19)

- 飞兆半导体附属公司崇贸科技荣获发明创作奖(05-14)

- Fairchild通过收购Xsens将战略步伐跨入 快速增长的3D运动追踪市场(05-15)

- Fairchild宣布2014年度北美洲和亚洲功率技术研讨会时间表(04-15)

- Fairchild与Xsens的结合水到渠成(06-09)