数字电路视频教程

由于工作的需要,我在数字视频处理方面做了几年的开发,我所说的开发是指应用层的开发,而不是底层的研究。先后开发出了几个产品,比如数字接口摄像头、图像采集卡、TV-VGA视频转换器、造纸行业用的在线斑点检测仪、数字伪彩色处理仪等,在开发中也了解了一些关于CMOS面阵传感器、CCD面阵传感器、CCD线阵传感器、高速摄像、高分辨率摄像、视频编解码、图像压缩等方面的知识,目前我还在继续做类似的开发。前面说的产品都有一定的销量,所以经常会收到用户打来的电话,大多数是咨询一些很基本的数字视频知识。数字视频无疑是复杂的,牵扯到很多方面,所以我有了写这篇文章的想法,我希望用尽量通俗的方式来说明一些基本的问题,以期能对读者的开发工作有一些帮助(说明一下:为了尽量地把问题说得简单一点,叙述中我作了一些简化,比如把U和Cb都说成U、V和Cr都说成V等。另外还需要说明的是,下面我所说的模拟视频的各个参数都是针对我国的电视标准——PAL制式而言的,而其它的电视制式则略有差别。读者在做进一步研究时请注意)。因为我的水平十分有限, 错漏难以避免,有兴趣的读者可以写信和我一起来探讨。

视频简单地说就是活动图像。电影也是活动图像,电影把大量静止图像记录在胶片上,一张一张地连续显示出来,就成了我们看到的电影。对于电视视频,每秒钟包含几十帧静止图像,每一帧静止图像由几百个行组成,每一行又由几百个像素点组成。1秒钟包含的图像帧数为帧频,1秒钟包含的总行数为行频,1秒钟包含的总像素数实际上就是相当于视频带宽。

首先来说说模拟视频。

遥想起来,在当年有限的条件下,用电子管做出电视机的前辈们实在是令人佩服的,但是,用现在的眼光来看,当年的电视技术又实在是很简陋的。我国的黑白视频信号帧频为25 Hz,就是说每秒显示25幅图像,之所以规定为25 Hz,而不是其它的某个值,主要是因为两个原因。一个与人的视觉生理特点有关,当图像的刷新速度达到5帧/秒的时候,人开始感觉图像是活动的,而达到24帧/秒的时候,人感觉图像是完全连续和流畅的(电影所使用的帧频就是24 Hz),所以视频信号帧频应大于等于24 Hz。理论上来说帧频越高越好,但是帧频越高,对电路的要求也越高,技术越复杂,成本也越高(现在有的电脑彩显帧频已达到200Hz),在当时的条件下,只能选择一个大于24的尽量小的值。另一个原因是因为我国的电网频率是50Hz,当采用25 Hz帧频时,隔行扫描时的场频为50 Hz,正好与电网同频,这样,电源对图像的干扰是固定的,人眼不容易感觉出来,或者换个角度说:电源就可以不必做得那么精密(那个时候开关电源还很少使用,整流电源缺乏稳压措施,纹波很大)。所以选择了25 Hz帧频。说到这里,又要说说“场频”。电视在显示图像的时候,把一帧分成了两场来显示,一个场由帧中的奇数行组成,叫做奇场,另一个场由帧中的偶数行组成,叫做偶场。之所以要这样做,主要是因为在CRT显象管上一秒钟显示25帧图像时,人眼感觉到连续性还是不太好,而且还有明显的闪烁,一帧分成两场后,场频为50 Hz,图像更加连续一些。当然还有一些别的原因,与电路设计方面有关。

我国的黑白视频信号规定每帧图像共625行,每场为312.5行,行频15625 Hz,视频带宽6MHz。在每场的312.5行中,有一些行要用作场消隐,是不包含视频信号的,按照CCIR656标准规定的行编号方法,奇场的行号为第1至312.5行,偶场的行号为第312.5至625行,其中,奇场的第23.5至310行包含有效的视频信号,共287.5行,偶场的第336至622.5行包含有效的视频信号,共287.5行。所以一帧中有效的总行数为576行,由最上面的半行加上中间的574行加上最下面的半行组成。(说到这里又要顺便说个问题,有经验的读者在PC机上用视频捕捉卡捕捉图像的时候,如果分辨率设定为720点*576行,会发现最上面的行左边半边是黑色的,或者最下面的行右边半边是黑色的,就是因为一场中包含有半行的无效行的原因。)

上面说的是黑白视频信号,那么彩色视频信号又是怎么回事呢?当科学家们开始研究彩色电视的时候,黑白电视已经大量使用了,所以最好彩色电视信号能够与黑白电视信号保持兼容,以便彩色电视信号在黑白电视机上能播放出黑白的图像。这个问题是很困难的,因为色度信号也要占用较大的带宽,而在电视射频频带上,一个频道挨着一个频道,亮度信号(实际上还有调频的伴音信号)已经把频带给塞满了,幸运

上面说的是彩色视频信号怎么加到原来的黑白视频信号中。那么彩色图像是怎么还原和显示出来的呢?我们知道,黑白图像的像素只能用亮度(灰度)来描述。而彩色图像的像素的描述要复杂一些,有很多不同的方法,比如在印刷行业中用的是CMYK(青、品红、黄、黑)四色合成的方法,而在计算机或电视机的CRT显象管中都是用的RGB(红、绿、蓝)三基色合成的方法,我也不明白为什么要选这三种颜色,而没选别的颜色,我猜想可能是因为人眼包含RGB三种色感细胞,所以用这三种基色能合成比较多的人眼能识别的彩色出来,或者因为这三种基色的荧光粉比较容易制造。通过RGB三基色来合成某种彩色,或者某种彩色怎样分解为三基色,这个是大家都熟悉的。用RGB三基色来表示彩色的确很直观,但是如果把这种方法用作图像传输则绝不是一个好的方法。第一个缺点是与黑白图像不兼容,把RGB三基色转换为灰度的方法是:灰度=R*0.3+G*0.59+B*0.11,这个转换过程显然是比较复杂的。对于电视机而言,就意味着必须解码出RGB信号才有可能得到黑白图像,而黑白电视机没有解码功能,所以不能实现兼容。第二个缺点是占用太多带宽,用RGB三基色表示图像,每个分量的带宽是均等的,都约等于亮度信号的带宽,所以对于每个分量,都要用较大的带宽来描述。第三个缺点是抗干扰能力差。由于G分量占有亮度值的59%,所以当G受到干扰的时候,像素的亮度值会受到很大的影响,而人眼对亮度值的变化是十分敏感的,所以图像主观质量会明显下降。基于这些原因,在视频信号传输中采用的是YUV合成的方法。Y代表亮度信息,U代表蓝色色差(就是蓝色信号与亮度信号之间的差值),V代表红色色差。我们来看看使用这种表示方法的优点。第一个优点是与黑白图像兼容。假定一个像素是用YUV表示的,我们只要忽略UV分量,取出Y分量,就可以得到像素的亮度值,从而把彩色图像转换为黑白图像。这样很容易实现彩色电视信号与黑白电视信号的兼容。第二个优点是节省带宽。说这个问题的时候要先说说大面积着色原理。实验发现,人眼对亮度信息是敏感的,主要通过亮度差别来分辨物体形状的细节,而对彩色信息是不敏感的,人眼区分不出物体颜色上的细小的变化,或者说人眼不容易觉察出来图像的色彩的细节部分的变化。因此,可以对亮度信号用较高的采样频率采样,而对色度信号用较低的采样频率采样(或者用较低的量化深度),比如几个相邻的像素的亮度值不同,但是却可以使用一个相同的色度值。这就是大面积着色原理。基于这个原理,在电视信号传输中,U或V信号的带宽远小于V信号的带宽,这样就节约了带宽。换个方式来说,比如在计算机中,用RGB方式描述一个像素需要R、G、B共3个字节。而用YUV方式描述,则对于每2个像素,Y用2个字节,U取相同的值,用一个字节,V取相同的值,用一个字节,平均每个像素2个字节。或者每个像素Y用一个字节,U用半个字节,V用半个字节,共2个字节。第三个优点是抗干扰能力强。由于亮度信号是单独表示的,所以如果色差信号受到干扰,不会影响到亮度,主观感觉噪声不会明显增加。

在电视机中,彩色视频信号首先分解为亮度信号Y和色度信号,色度信号再分解为U色差信号和V色差信号,最后由YUV三个分量经过矩阵运算变换为RGB信号,以便在显像管上显示。那么YUV具体是怎样变换为RGB呢?这个问题又叫做“彩色空间变换”,我将在本文的后面详细地讨论这个问题。

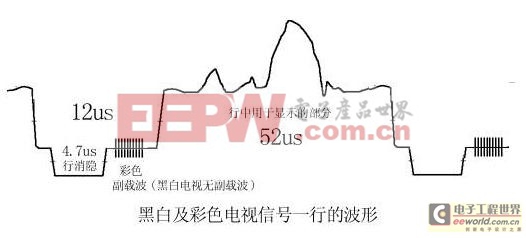

通过前面的讨论,我们已经知道:黑白视频信号带宽6 MHz,由帧、场、行、像素等组成,像素用亮度值Y来描述。彩色视频信号在黑白视频信号中插入了一个带宽1.3 MHz的色度信号,由这个信号来得到UV色差信号,最后把YUV变换为RGB来描述像素。

现在我们来分析一下视频信号的缺点。1、帧频低。视频信号的帧频只有25 Hz,必然导致图像闪烁。2、分辨率低。在一帧中有效的行只有576行。由于采用了隔行扫描,一帧图像要由连续的两场来拼合而成,而实际上很难保证两场中的行准确地错开(对准间隙),这进一步导致垂直方向的分辨能力损失。3、亮色串扰。亮度信号和色度信号混合在一起,解码的时候不能很好地分开,导致亮度信号和色度信号互相干扰。4、缺乏改进余地。除非重新制定新的标准,否则前面提到的三个问题在现有基础上都很难改进。视频信号格式有这么多缺点,是因为受当年制定这个标准时的技术条件制约造成的,而近年来通过在电视中加入一些数字处理的手段,比如倍频扫描(100 Hz场频)、使用数字梳状滤波器等方法,电视的图像质量也得到一些提高。而现在正在研究的数字电视,是重新制定的全新的标准,用以获得胶片质量的图像,可能会彻底淘汰现在的视频标准和电视设备,当然这是将来的事情,也不是我讨论的主题。

我想讨论的是“数字视频”,而前面说的都是模拟视频,这是因为我所说的数字视频是现有的模拟视频的数字表示,先搞清楚了模拟视频,下面的讨论就很简单了。

模拟电路 模拟芯片 德州仪器 放大器 ADI 模拟电子 相关文章:

- 12位串行A/D转换器MAX187的应用(10-06)

- AGC中频放大器设计(下)(10-07)

- 低功耗、3V工作电压、精度0.05% 的A/D变换器(10-09)

- PIC16C5X单片机睡眠状态的键唤醒方法(11-16)

- 用简化方法对高可用性系统中的电源进行数字化管理(10-02)

- 利用GM6801实现智能快速充电器设计(11-20)