浅谈“深度学习”发展遭遇的若干个瓶颈

里被称之为"建模"),为了避免丧生或者缺胳膊少腿,绝大多数人都能快速地学习到不被车撞到的要领。

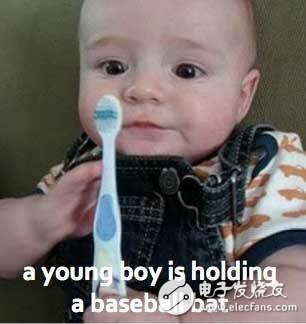

虽然现在已经有了比较大的进展,一些神经网络可以从数据层面,在相当大的样本数量上给出一个惊人的成果,但是它们如果单独拿出一个出来,都是不可靠的,所犯的错误是人一辈子都不可能犯的,比如说错把牙刷当作篮筐。

数据质量的不稳定性带来的是:不可靠、不准确,以及不公平。

而且,你的结果,还得取决于输入的数据质量如何。神经网络中如果输入的数据是不准确的,不完整的,那么结果也会错的离谱,有些时候不仅造成损失,而且还会很尴尬。就比如说Google图片错把非裔美国人当作了猩猩;而微软曾经试着把一个人工智能放在Twitter上进行学习,几个小时之后,它就变得充满恶意,满口脏话,带有严重种族歧视。

也许推特上的这个例子有些极端,但不可否认,我们输入的数据本身就存在着某种程度的偏见和歧视,这种带有主观性的,潜移默化的观念或者暗示,有时我们甚至自己都无法察觉。就比如说:word2vec是google推出的做词嵌入(wordembedding)的开源工具,从GoogleNews里提取了300万个词。这组数据传递出来的信息包括了"爸爸是医生,妈妈是护士。"这明显就带有性别上的歧视。

这种歧视不仅仅是被原封不动地搬运到了数字世界,而且还会得到放大。如果"医生"这个词更多的指向"男人"而非"女人",那么算法在面对一份公开的医生职位筛选的时候,它会将男性放在女性前面优先考虑。

除了不准确、不公平,还存在着最大的风险:不安全。

"生成对抗式网络"(GAN)的发明人IanGoodfellow提醒我们:现在的神经网络可以很容易被不轨之徒操纵。他们可以以一种人的肉眼无法识别的方式,篡改图片,让机器错误地辨识这个图片。

左边的是熊猫(机器的确认度是57.7%),加上中间的这层图片之后,机器的确认度上升到了99.3%,认为图片上出现的是长臂猿。

不要小看这样的风险,这种恶意篡改人工智能系统的做法,会带来极大的危害,尤其是被篡改的图片和最初的图片在我们看来完全是一回事。比如说无人自驾驶汽车就会受到威胁。、

以上就是深度学习所存在着的种种瓶颈,目前它要发挥作用所需要的前置条件太过苛刻,输入的数据对其最终的结果有着决定性的影响,另外,它存在着很多漏洞,安全性也无法得到保证。如果我们要驶向理想中的人工智能未来,这些瓶颈还有待于人们的进一步的突破与挑战。

声明:电子发烧友网转载作品均尽可能注明出处,该作品所有人的一切权利均不因本站转载而转移。作者如不同意转载,即请通知本站予以删除或改正。转载的作品可能在标题或内容上或许有所改动。

- 机器学习算法盘点:人工神经网络、深度学习(07-02)

- 2016年人工智能与深度学习领域的十大收购(07-26)

- AI/机器学习/深度学习三者的区别是什么?(09-10)

- 深度学习的硬件架构解析(10-18)

- 麻省理工科技评论评选的14大医疗领域突破科技(上)(10-14)

- 探秘机器人是如何进行深度学习的(09-18)