自动驾驶的“眼睛”:第一种摄像头,第四种等你开发!

自动驾驶可能算是未来20年高科技王冠上最耀眼的一颗明珠了,所以科技圈有点身份和想法的人都想垫着脚尖够一够。想象一下,让用户松开方向盘,摆脱驾驶之"苦",尽享乘坐之"乐",确实是一幅极具说服力的画面。但想要"入画"并不简单,一个重要的先决条件就是:能够找到一种代替人眼的传感技术,在驾驶过程中完成物体探测、分类、交通信号识别、距离和速度判断等功能,这样用户才有信心做个放心的"睁眼儿瞎",将驾驶权交出去。

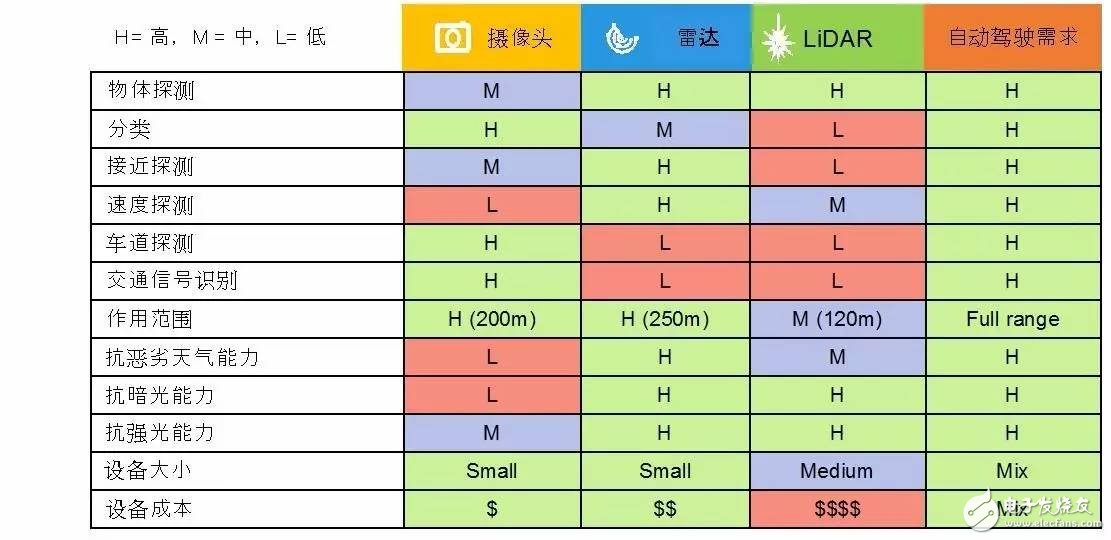

目前来看,有三种有望替代驾驶员眼睛的传感技术:摄像头、雷达(RADAR)和激光雷达(LiDAR)。

图1,用于自动驾驶的摄像头、雷达和LiDAR三种传感技术比较

光学摄像头是和人眼成像机理最相似的技术,也是三种技术中唯一一个可以获取物体颜色、对比度、材质等细节图像信息的技术,所以在分类识别方面优势明显。同时和人眼一样,摄像头容易受制于外部环境的影响,天气好坏、环境光明暗等都会对其性能造成致命影响。再有,光学传感对于两个移动物体的相对运动探测有天生的缺陷,所以在速度侦测方面能力较弱。不过,摄像头有个最大的竞争优势:成本低。不断降低的图像传感器成本、成熟的嵌入式图像处理方案,大大拉低了应用门槛,所以很多厂商都将光学摄像头作为通往ADAS和自动驾驶的敲门砖,预计到2030年车用摄像头单元的数量将达到4亿部,领先其他两个技术一个数量级。

雷达作为第二种候选传感技术,它的机理是向空间中发射电磁波,并通过监测反射回波来探测周围物体的状态。雷达在汽车中应用的历史并不短,目前车载雷达包括短距雷达(SRR,0.2~30米)、中距雷达(MRR,30~80米)和长距雷达(LRR,80~200米)三类,其中前两者因在泊车辅助和盲区探测等方面的应用为人们所熟悉,但近年来LRR开始在ADAS中显示身手,被应用于自适应巡航(ACC)、自动紧急制动(AEB)、碰撞预警(FCW和BCW)等系统。不过现实中,雷达在一些特殊驾驶情境的侦测和判断的准确性上仍让存在问题,如对突然并线插入的车辆的侦测、由于弯道误判同一车道中前方车辆的距离等等,这也限制了其在自动驾驶中的应用空间。

LiDAR和雷达都是一种主动探测技术,不同的是其发射并由周围物体反射回来的不是电磁波,而是激光,因此其在探测精度和速度上优势明显。LiDAR在汽车上的应用被世人所关注,可以追述到2007年DARPA(美国国防高级研究计划局)自动驾驶挑战赛。由于能够提供360° 度3D视野内全方位的物体探测,LiDAR逐渐成为自动驾驶研究的标配,看着高高架在谷歌和百度们自动驾驶原型车车顶上的LiDAR装置,总让人有种"不明觉厉"的赶脚。但是作为车载传感技术的"新贵",LiDAR的最大问题是真的有点儿"贵",有些系统甚至超过了汽车的价格,难以让人消受。因此目前用固态LiDAR(SSL)取代依靠机械转动装置的扫描式LiDAR是一个趋势,尽管前者的视角(FOV)有限,但是成本低、可靠性能好,更符合消费级汽车应用的"调性"。

图2,针对ADAS和自动驾驶的三种的传感器组合

不难看出,目前我们手中的这三个传感技术,相较于自动驾驶的理想,都难称完美。因此一个可行的解决方案,就是将三者进行融合,各取所长。由此也催生了"传感器融合(Sensor Fusion)"技术的发展,就是将不同传感器收集的数据综合在一起进行计算和处理,对被测物体的特征、空间位置、运动状态的信息作出准确的识别和判断。

但对于自动驾驶来说,能"看见"周围的环境,这种感知能力似乎还不够,开发者还通过V2X技术让汽车具有一种"超视距"的能力。V2X,就是让汽车与其他汽车或周围的交通设施建立快速、可靠的无线通信,彼此交互信息,进行判断和决策。这样既可以有效克服障碍物造成的"视觉"死角,还可以通过其他联网的汽车和基础设施获取更广范围内的交通信息,这时汽车已经不再是一个孤立的个体,而是成为整个智慧交通系统中的一个节点。这时帮用户看路的,将是整个智能交通CPS(信息物理系统)。如若成真,驾驶员的眼睛,真的可以退休了。

图3,安富利基于NXP i.MX6D开发的ADAS解决方案

安富利基于NXP i.MX6D开发的ADAS解决方案可以实现盲点监测(BSM)、前方碰撞预警(FCW)、车道偏离报警(LDW)、夜视系统(NVS)、泊车辅助(PA)、行人检测系统(PDS)、道路信号识别(RSR)、全景摄像头(SVC),是向最终的自动驾驶迈出的坚实的一步。

- 自动驾驶技术将在这7个方面改变我们的生活(09-10)

- 看日系三大品牌如何推进自动驾驶(02-28)

- 技术详解特斯拉Model S首起致命车祸 后续如何避免?(06-04)

- 【科普】到底什么是真正的自动驾驶汽车(07-15)

- 自动驾驶技术到底什么时候能成熟?(09-12)

- 汽车自动驾驶技术都有哪些?(09-20)